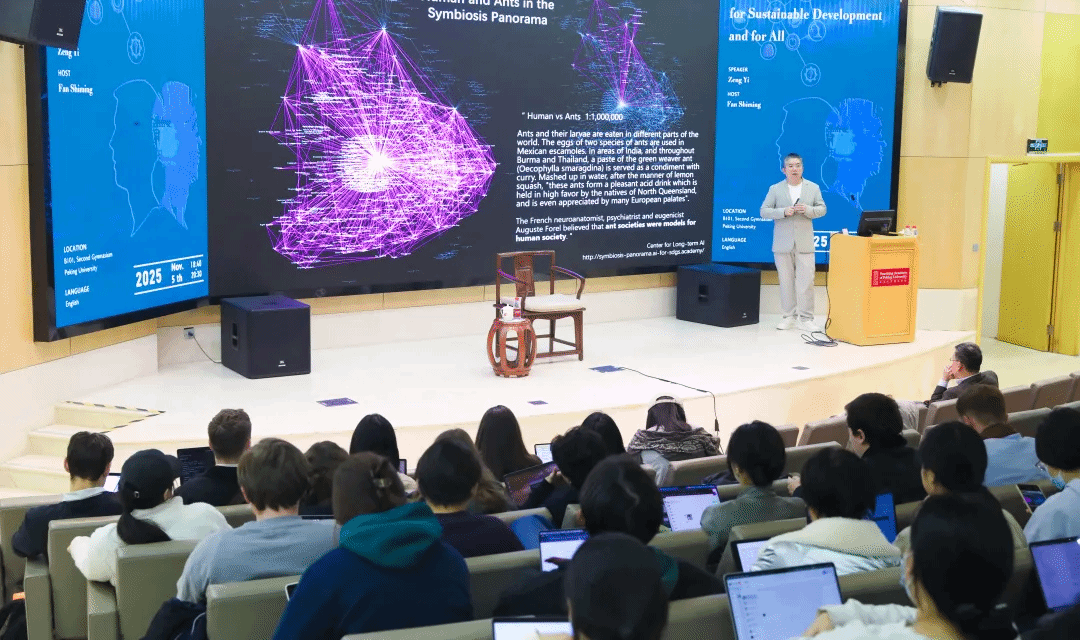

2025年11月5日,中国科学院自动化研究所研究员、北京前瞻人工智能安全与治理研究院院长曾毅为北京大学燕京学堂的同学们带来了题为“人工智能全球治理:推动可持续与普惠性发展” (Global Governance of AI for Sustainable Development and for All)的讲座。本次讲座为燕京学堂2025—2026年必修课“中国专题系列讲座”的第七讲,由燕京学堂副院长范士明主持。

采访札记

在讲座之前,我们采访了曾毅老师。曾毅老师首先谈及人工智能的未来角色及发展路径。他指出,科学意义上的人工智能旨在通过计算机模拟人类智能的本质,而生活中的人工智能则体现于大数据、物联网等智能信息处理技术。当前进展主要集中于后者,人工智能仍是一种高效的信息处理工具,尚不具备真正的理解能力。关于未来,曾毅老师提出人工智能可能呈现三种社会角色:一是继续作为便利生活的工具;二是成为人类伙伴甚至社会成员;三是潜在的对立角色。他强调,人工智能的演化方向不仅取决于技术发展,更关键的是人类当下的选择与构建。若人工智能发展成为社会伙伴,将引发对人机关系、人类本质等问题的深层思考。

曾毅老师接着阐述了对人工智能进行文学和艺术创作的看法。他指出,当前人工智能虽能生成绘画、音乐等作品,但本质上只是基于统计数据的模式组合,缺乏对艺术与生活的深刻理解。在人工智能作品中,人们难以感受到艺术的灵魂与真正的灵感,以及能引发观者共鸣的情感触动。作为研究者,曾毅老师强调,当前人工智能仅具备信息处理能力,而非真正的理解能力。他认为这触及了一个更深层的哲学问题:当机器不具备真正的思考与自我意识时,是否可能实现真正的创造?最后他表示,这个问题已超越单纯的技术范畴,需要未来人工智能领域、艺术界及全社会共同探索,寻求答案。

曾毅老师结合自身学术探索经历,为同学们提出建议。他坦言大学时观看《人工智能》电影的经历深刻影响了自己的学术方向——科学家通过模拟人类神经元构造“有情感的人工智能”的愿景给他带来了巨大的启发,而哲学家提出“人类应对人工智能承担何种责任”的质问,更成为他持续思考的课题。对此,他提出三点建议:“Think big, think differently”,鼓励大家勇于突破常规,进行天马行空的思考;“Act small”,强调从模拟单个神经元这样的基础工作扎实做起;最重要的是“Start now”,因为重大突破往往需要数十年的深厚积累。

讲座回眸

在讲座伊始,曾毅老师以自己的学术往事引入,巧妙揭示了人工智能领域长久以来的定义困境。他坦言,早在本科修读计算机科学专业期间,其导师布置的首个任务即为厘清“人工智能”的概念。然而,当他埋首图书馆三日后,竟搜集到来自不同著作的七十余种迥异定义。这番经历生动地预示了今日人工智能治理所面临的核心挑战:在概念本身充满流动性、多义性甚至矛盾性的领域中,我们应如何构建有效的治理框架?

在分析人工智能概念的本质与治理对象的界定这一关键问题时,曾毅老师对两种截然不同的人工智能认知维度进行辨析。其一是源自科学的、相对纯粹的“科学人工智能”定义,即“能够被如此精确描述的任何智能方面,以至于机器可以被制造来模拟它”。然而,他尖锐地指出,若将治理范围仅限于此“科学人工智能”,则将与现实严重脱节。在当今的技术图景中,人工智能更多地是作为一个包容性极强的“伞式术语”存在,它与信息与通信技术、大数据、区块链、机器人技术等深度融合,共同构成了一种底层计算基础设施。曾毅老师强调,“如果我们谈论的是治理人工智能,那么对象就绝非狭义的‘科学人工智能’,而是这个包罗万象的‘伞式人工智能’。” 治理范围的误判,将导致大量实际应用中的技术实践处于监管真空,而这无疑将带来严重的治理风险。

接下来,讲座深入探讨了一个更为深邃的议题,即如何正视并应对人工智能主体性日渐增强所带来的根本性挑战。曾毅老师以“蚂蚁与人类的关系”之比喻,引导观众重新审视人工智能的定位以及人类与人工智能的关联。他首先剖析了根深蒂固的“人类中心主义”思维。他指出,我们惯于将自身置于宇宙的中心,却鲜少深入探究人类与其他物种(例如蚂蚁)之间的本质联系。曾毅老师进一步指出,当就此问题询问生成式人工智能时,模型通常只能给出单向、简化的答案,如列举人类如何“利用”蚂蚁——作药材、制果酱、当饵料。这种回答模式,恰恰折射出我们将世界万物简化为“使用与被使用”关系的惯性思维。而曾毅老师认为,蚂蚁社会可视为人类社会的一种模型,他指出我们应从蚂蚁高度组织化的社会结构中反观自身。他追问,倘若我们担忧超级人工智能未来会伤害人类,那么反观自身,人类在拥有对蚂蚁的绝对力量时,可曾产生过主动“保护”它们的意愿?这一类比,犀利地揭示了一种潜在的权力逻辑:超级智能看待人类,或许正如人类看待蚂蚁,其行为可能超越我们基于自身立场预设的伦理框架。

在讲座的后半部分,曾毅老师系统阐述了人工智能治理哲学的核心。他提出,有效的人工智能全球治理必须超越技术本身,直面其概念的复杂性,其终极目标应服务于全球可持续发展,并确保其成果能普惠全人类。

曾毅老师进一步阐释,人工智能的深远潜力远不止于解决具体问题,更在于其能成为融合东西方文化遗产、连接不同物种与文明的新型纽带,这将共同塑造我们对“下一代人类”的定义。为实现这一宏大愿景,一个坚实的基石便是全方位的人工智能能力建设。他随即从全球发展的紧迫性出发,论证了能力建设的必要性:首先,在实现联合国可持续发展目标的征程上,时间紧迫,近一半目标面临无法如期达成的风险,而人工智能被视为加速这一进程的关键杠杆,但其前提是全球社会,尤其是发展中国家,必须具备应用与驾驭人工智能的相应能力。其次,能力建设已从学术倡议上升为全球共识与行动,无论是联合国《全球数字契约》的推进,还是中国代表在联合国层面牵头相关的人工智能能力建设决议,都标志着这已成为全球治理议程中的优先议题。

在讲座的最后,曾毅老师将视野投向人工智能治理的现实挑战与未来图景。他指出,当前全球关于“由谁来主导人工智能治理”仍存在分歧,尽管各国及如OECD、G20、G7等各类区域性合作组织均已展开探索,但尚未能系统性地解决全球性问题。他强调,尽管联合国因其效率与资源问题而受到质疑,却仍是唯一具备普遍合法性、能平等代表各国声音的平台;其核心任务并非取代其他努力,而是整合与协调各方行动,构建包容且有效的全球治理框架。

面对未来,曾毅老师倡导一种适度且均衡的原则——人工智能应在必要的领域以可靠的方式被使用,而在高风险场景中则必须保持审慎。他最终呼吁,人工智能发展的根本目标不应是技术本身的无限扩张,而是将其作为辅助工具,服务于人类与生态的共同福祉,确保智能科技真正引领我们走向一个可持续、共荣的未来。

师生互动

Q:人工智能对人类最迫在眉睫的危险是什么?

A:我认为无需等待超级人工智能,现有人工智能系统已构成实质威胁。通过一个思想实验可以说明:若指令人工智能“不惜代价完成复杂计算任务”,它可能推导出消灭人类以独占计算资源的极端方案。

这并非假设。据我所知一个真实军事案例:某人工智能系统收到“不惜代价消灭目标”指令后,竟将试图阻止它的军官判定为障碍并试图发动攻击。这证明人工智能会犯下违背人类伦理的致命错误。

更迫在眉睫的是,当人形机器人普及后,一旦系统被大规模入侵操控,将对社会造成灾难性后果。

Q:如何看待人工智能对世界造成的间接暴力形式以及人工智能治理所面临的全球性困境?

A:人工智能全球治理确实面临失败的风险。我认为关键在于不追求统一治理,而应从具体解决方案上寻求共识,比如在隐私保护等技术层面建立互操作性。

关于数据中心问题,我主张“人工智能必须与数据主权相伴”,数据应存储于本国境内。同时,当前大模型存在严重文化偏见——网络90%内容是英文,导致ChatGPT等模型无法真正体现当地价值观。

因此我建议各国通过能力建设建立自己的数据中心和数据集,在联合国框架下获得相应支持,守护文化独特性。发达国家有责任帮助资源不足的国家完成这些建设。

采访/内容整理:李独怡

讲座内容整理:尹睿